ChatGPTの情報漏洩リスクとは、ChatGPTに入力した業務データや機密情報が、外部サービス上での保存・共有や不正アクセスなどを通じて意図せず外部に流出する危険性を指します。

ChatGPTは、データ分析の支援や顧客対応の自動化など、業務の生産性向上に大きく貢献する一方で、利用方法を誤ると情報漏洩の原因となります。実際に、従業員がChatGPTへ機密情報を入力したことで情報が流出した事例も報告されており、適切な対策なしでの業務利用は企業にとって重大なリスクです。

そこで本記事では、ChatGPTの情報漏洩に関する以下の内容を詳しく解説します。

- ChatGPTの現状

- 情報漏洩が発生した具体的な事例

- ChatGPT利用時に実施すべき対策

- より安全な活用方法

生成AIの恩恵を最大限に享受しつつ、リスクを最小限に抑えるためのポイントをお伝えします。ChatGPTを業務で利用している方、導入を検討している方は、ぜひご一読ください。

ChatGPTの現状とリスクの認識

ChatGPTの急速な進化と今後の展望

ChatGPTは2022年11月のリリース以来、卓越した性能で世界中の注目を集めています。OpenAIによって開発されたChatGPTは、2023年の「GPT-4」、2024年の「GPT-4o」と、驚異的な速さで進化を遂げてきました。

現在、ChatGPTの利用は産業界や教育分野など、幅広い領域で本格化しつつあります。自然な対話能力や高度な文章生成力は、多くの業務や学習プロセスに革新をもたらしています。

ChatGPTをはじめとする生成AIは、多くの組織にとって不可欠な存在といえるでしょう。今後も、さらなる技術の向上と社会への浸透が期待されています。

一方で、急速な普及に伴い、情報セキュリティの観点から新たな課題も浮上しています。ChatGPTの活用が進む中、利点を最大限に活かしつつ、潜在的なリスクにも適切に対処することが重要です。

AIを用いて高度化するサイバー攻撃

AIの進化に伴い、サイバー攻撃も高度化しています。例えば、ChatGPTをはじめとした生成AIを悪用すると、ターゲットに適した自然な日本語のフィッシングメールを作成可能です。実在する企業を装ったメールを送信し、偽サイトに誘導して情報を盗む手口が散見されています。

このようなAI活用型の攻撃に対応するため、企業には従来以上に高度なセキュリティ対策が求められます。AIを悪用した攻撃にも対応できるよう、既存の対策をアップデートする必要があるでしょう。また、AIの進化スピードは速いため、人手に頼らない自動化された対策の導入も重要です。

企業は新しい脅威を認識し、常に最新の対策を講じることが欠かせません。AIの利点を活かしつつ、リスクにも十分に備えることが、今後のサイバーセキュリティの鍵となります。

入力を悪用する攻撃「プロンプトインジェクション」のリスク

生成AIの普及に伴い、新たなサイバー攻撃として注目されているのが「プロンプトインジェクション」です。これは、生成AIに対して意図的に悪意のある指示を与え、接続先のシステムやデータから本来取得できない情報を引き出したり、不適切な動作を誘発したりする攻撃手法を指します。

ChatGPTのような対話型AIでは、入力内容次第で出力が変わるため、外部からの入力をそのまま処理する設計になっている場合、情報漏洩や誤った処理につながるリスクがあります。特に、社内データと連携したシステムでは影響が大きくなるため注意が必要です。AIを活用する際は、入力内容の制御や権限管理を徹底し、こうした攻撃を想定した設計・運用を行いましょう。

▼関連記事

ChatGPTで情報漏洩が発生した事例

ChatGPTの急速な普及に伴い、実際に複数の情報セキュリティインシデントが報告されています。これらの事例を理解することで、どのようなリスクが存在するのか、具体的に把握できるでしょう。

企業の機密情報漏洩

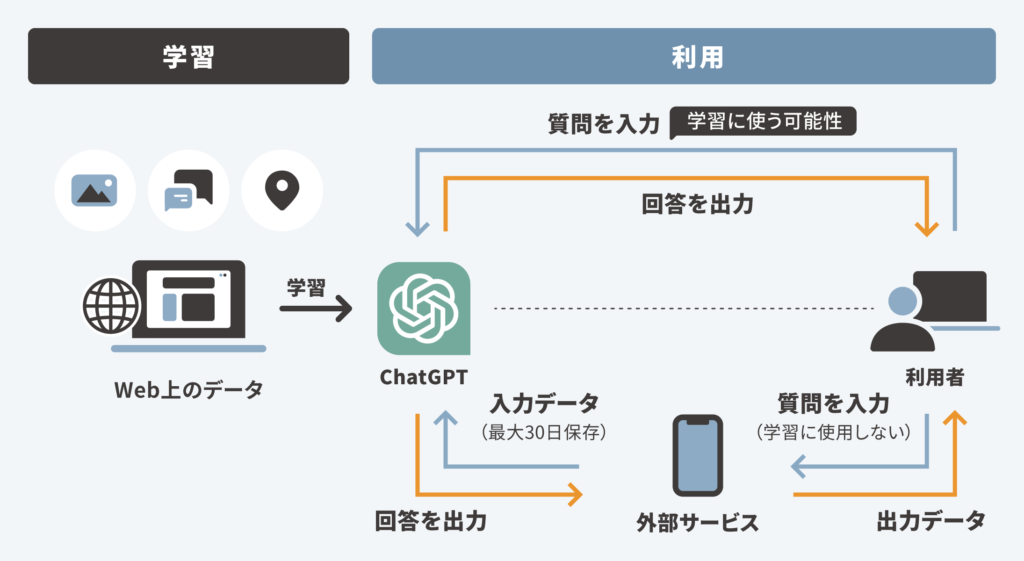

ChatGPTでは、AIへの指示文であるプロンプトの記載内容を学習し、回答生成に活用します。そのため、プロンプトに機密情報を含めるとAIに学習され、他のユーザーの回答に転用されるおそれがあります。

実際に2023年3月、韓国の大手電子製品メーカーで情報セキュリティインシデントが発生しました。ChatGPTにソースコードを入力してプログラムのエラー解消を図ったことや、機密情報を含む社内会議の録音内容を入力したことが原因でした。

バグが原因のチャット履歴漏洩

ChatGPTのシステムにバグが発生し、ユーザーのチャット履歴タイトルが他のユーザーの画面に表示されるインシデントが起きました。OpenAIはインシデント発生時、ユーザーからの報告を受けてすぐにChatGPTのサービスを一時停止しました。数時間後には不具合が解消され、サービスを再開しています。

幸いにも会話の本文は表示されませんでしたが、機密情報を含むタイトルが他者の目に触れる可能性があったため、大きな問題となりました。ユーザーは常にシステムの不具合のリスクを念頭に置き、機密情報の取り扱いには細心の注意を払う必要があるでしょう。

ユーザーの個人情報の流出

2023年3月、有料版であるChatGPT Plusのユーザーの個人情報が流出するインシデントが発生しました。インシデントの内容は、名前・住所・クレジットカード情報の一部といった機密性の高い情報が、他のユーザーのサブスクリプション管理画面に表示されるというものです。通常、個人情報は各ユーザーが自身のアカウントでのみ閲覧できるはずでした。

今回のインシデントでは、ChatGPT Plusに加入しているユーザーの約1.2%の情報が、約10時間にわたって流出しています。

※出典:ChatGPT「March 20 ChatGPT outage: Here’s what happened」

企業が直面するガバナンスとリスク

実際の事例から明らかになったように、ChatGPTの利用には様々なリスクが存在します。特に企業での利用においては、組織全体での管理体制の構築が急務となっています。

組織レベルでのガバナンス課題

情報システム部門にとって、ChatGPTの利用統制は複雑な課題です。従業員が個人アカウントで無許可にChatGPTを利用することで、企業の機密情報が意図せず外部に流出するリスクが存在します。特に、シャドーIT化したChatGPT利用は、IT部門の管理下にないため、セキュリティポリシーの適用が困難になります。

また、部門ごとに異なる生成AIツールを導入することで、セキュリティレベルの統一が困難になる問題もあります。営業部門ではChatGPT、開発部門ではGitHub Copilot、マーケティング部門では別の生成AIサービスを使用している場合、情報管理の一元化が困難になり、リスクの可視化ができなくなります。

さらに、ChatGPTの利用ログの管理も重要な課題です。どの従業員が、いつ、どのような情報をChatGPTに入力したかを追跡できる仕組みがなければ、インシデント発生時の原因究明や影響範囲の特定が困難になります。

開発現場特有のセキュリティリスク

ソフトウェア開発の現場では、ChatGPTやGitHub Copilotなどのコーディング支援AIの利用が急速に拡大しています。開発チームでは、AIによるコード生成の利便性を享受する一方で、新たなセキュリティリスクに直面しています。

ChatGPTにコードレビューを依頼する際、機密性の高いソースコードや企業の技術仕様を入力してしまうことで、重要な知的財産が外部に漏洩するリスクがあります。特に、APIキー、データベース接続情報、暗号化キーなどの機密情報がコードに含まれている場合、これらがAIサービスに送信されることは重大なセキュリティ脅威となります。

また、ChatGPTが生成するコードの品質とセキュリティも懸念事項です。AIが生成するコードには脆弱性が含まれている可能性があり、そのまま本番環境に組み込まれると重大なセキュリティホールになる危険性があります。

こうした組織レベル・開発現場レベルでのリスクを踏まえ、次に具体的な対策について解説します。

ChatGPTを利用する際に実施すべき情報漏洩対策

ChatGPTを活用する際は、適切な情報漏洩対策を講じることが不可欠です。以下の対策を実施することで、情報漏洩のリスクを軽減できます。

- 個人情報や機密情報を入力しない

- チャット履歴を残さない設定にする

- API連携を活用する

- ChatGPTの企業向けプランを利用する

ChatGPTの活用にあたっては、対策を組み合わせて実施し、常にセキュリティ意識を持って利用しましょう。

1.個人情報や機密情報を入力しない

ChatGPTの情報漏洩リスクを減らすには、個人情報や機密情報を入力しないことが重要です。

ChatGPTはユーザーがプロンプトに入力した情報を学習し、他の質問への回答に活用する仕組みを持っています。入力した機密情報はサーバーに保存されるため、意図せず社外へ流出することも。さらに、保存された機密情報が他のユーザーへの回答に転用されるおそれもあります。

対策として、プロンプトに情報を入力する際は、機密情報に該当する部分をダミー情報に置き換える方法が有効です。実際の社名や数値を架空のものに変更してから入力すれば、情報の機密性を保ちつつChatGPTを有効活用できるでしょう。

2.チャット履歴を残さない設定にする

情報漏洩のリスクを減らすには、チャット履歴を残さない設定にするのが有効です。ChatGPTでは自動的に入力履歴を保存する仕様ですが、「Chat history & training」の設定をオフにすると、過去のやり取りを記録しない状態にできます。

チャット履歴を残さない設定にすれば、不要なデータ削除の手間が省けます。企業で複数の社員がChatGPTを活用する環境では、履歴管理が楽になるでしょう。また、アカウントが不正アクセスされても、過去の履歴を閲覧される心配が少なくなります。

ただし、履歴保存の設定をオフにしても、OpenAIでは不正利用監視を目的としてデータが30日間保存されます。さらに、チャット履歴を残さないと過去のやり取りを参照できなくなるため、頻繁に使用するプロンプトや必要な情報は、別途メモしておくなどの工夫が必要でしょう。

3.API連携を活用する

ChatGPTを安全に使用するには、API連携が有効です。APIとは、アプリケーション間の通信を可能にするインターフェースを指します。OpenAIが提供する「ChatGPT API」を利用すれば、自社のアプリケーションとChatGPTのAI技術を連携できます。

以前のChatGPTは、ブラウザから使用するWeb版のみでした。Web版のデータ利用規約は「オプトアウト形式」で、ユーザーがデータ利用を拒否しない限り、入力情報が学習される仕組みです。そのため、Web版ではプロンプトに入力した情報が他のユーザーの回答に転用されるおそれがあります。

一方で、ChatGPT APIを利用する際はデータの利用規約がオプトアウト形式から「オプトイン形式」に変更されます。オプトイン形式は、ユーザーがデータ利用を承諾しない限り、入力情報が利用されない仕組みです。つまり、API連携によって既存サービスにChatGPTの機能を組み込めば、他のユーザーに入力データが転用されません。機密情報の漏洩リスクを大幅に低減しつつ、自社の情報をAIに学習させて独自のChatGPTモデルを構築することも可能です。

また、API連携によって既存のアプリケーションにChatGPTの機能を組み込めば、業務効率の向上や顧客サービスの改善も期待できます。

4.ChatGPTの企業向けプランを利用する

情報漏洩対策として効果的な方法の一つに、ChatGPTの企業向けプランの利用があります。

2023年8月に発表された「ChatGPT Enterprise」は、企業のセキュリティニーズに応えるプランです。ユーザーが入力した情報をAI学習に使用されないため、情報の安全性が向上します。さらに、すべての会話データが暗号化され、チャット履歴の漏洩リスクも最小限に抑えられます。

2024年1月には、小規模組織向けに「ChatGPT Team」の提供も開始されました。Enterpriseと同様、入力データは学習に利用されない設定となっています。

企業向けプランを利用すれば、ChatGPTの高度な機能を活用しつつ、情報セキュリティを強化できます。企業の規模や需要に応じて、適切なプランを選択しましょう。

ChatGPTをより安全に活用する方法

ChatGPTをより安全に活用するには、以下の3つ方法を実施するのが有効です。

- 社内におけるChatGPTの利用ガイドラインを明確化する

- アカウント管理を適切に行う

- ChatGPTと連携できるセキュリティに配慮したツールを導入する

ChatGPTの動向にも注意を払いながら、安全かつ効果的に活用していきましょう。

社内におけるChatGPTの利用ガイドラインを明確化する

ChatGPTの情報漏洩リスクを最小限に抑えるには、社内での利用ルールを明確にし、社員に周知することが不可欠です。具体的なガイドラインを作成すれば、ChatGPT使用時の注意点を明確に示すことができます。ガイドラインには、ChatGPTの利用用途や入力禁止情報の指定、生成された文書の管理方法などを含めるとよいでしょう。

さらに、ガイドライン作成後は社員への教育も重要です。企業はルールの徹底を促すとともに、ChatGPTの安全な使用方法について定期的な研修を行うことが望ましいでしょう。

ガイドラインを実効性のあるものにする「AIガバナンス」

社内でChatGPTの利用ガイドラインを策定しても、それが形だけになってしまっては十分な対策とはいえません。現場でルールが守られず、結果として機密情報の入力や不適切な利用が発生してしまうケースも少なくないためです。

こうしたリスクを防ぐために重要なのが「AIガバナンス」の考え方です。AIガバナンスとは、AIの利用ルールを定めるだけでなく、運用・監視・教育まで含めて組織全体で統制していく仕組みを指します。

例えば、利用範囲の明確化や従業員への継続的な教育を行うことで、ルールの形骸化を防げます。ChatGPTを安全に活用するためには、ガイドライン策定とあわせて、実効性のある運用体制まで整備することが重要です。

▼関連記事

アカウント管理を適切に行う

ChatGPTでは過去にアカウント情報の漏洩が発生しているため、ユーザー側でも適切にアカウント管理を行う必要があります。アカウント情報が外部に漏れると、第三者が容易にログインし、不正利用するおそれがあります。

ChatGPTはID・パスワードでログインする仕組みを採用しているため、定期的なパスワード変更を習慣づけることが重要です。複雑で推測しにくいパスワードを設定し、定期的に更新することで、セキュリティレベルを高められます。

また、共有アカウントの使用は避け、個人ごとにアカウントを作成しましょう。万が一情報漏洩が起きた際、被害範囲を特定しやすくなります。

セキュリティに配慮したツールを導入する

このように、ChatGPTの活用にはセキュリティを意識した使い方が求められます。また、最近ではChatGPTを活用しながらも、セキュリティに配慮して開発されたツールも登場しています。

- データ損失防止(DLP)ソリューション

- ChatGPTを活用したツール

上記のツールを利用すれば、安心して生成AIを業務に取り入れることができるでしょう。

データ損失防止(DLP)ソリューションの導入

ChatGPTの情報漏洩リスクに対するシステム面での対策として、データ損失防止(DLP)ソリューションの導入が効果的です。DLPは、事前に設定した条件に基づいてデータを監視し、機密情報の不適切な送信やコピーを防止するシステムです。

DLPの主な機能には、以下のようなものがあります。

- コンテンツの監視

- デバイス制御

- 印刷・コピーの制限

- 特定のWebサイトへのアクセス制限

- リスクの高いメール送信のブロック

ChatGPTと連携すると、機密情報や個人情報などの送信を試みた際に、警告を発して行動を制御します。ユーザーが意図しない情報漏洩を未然に防ぐことが可能です。

DLPの導入は、人為的ミスによる情報漏洩リスクを大幅に軽減し、ChatGPTの安全な利用を支援する強力なツールとなるでしょう。

ChatGPTを活用したツールの導入

ChatGPTを活用していても、セキュリティに配慮したツールなら安心して業務に取り入れられます。

例えば、ChatGPTを活用したクラウド型Webアプリケーション脆弱性診断ツール「AeyeScan」は、以下の認証を取得しており、高いセキュリティ基準を満たしています。

- 情報セキュリティマネジメントシステム(ISMS)

- ISMSクラウドセキュリティ認証

AeyeScanでは、ChatGPTの自然言語処理能力を利用し、巡回してほしい箇所をフリーフォーマットで指示できます。また、診断設定もフリーフォーマットで指示できるほか、診断結果をもとにしたエグゼクティブサマリの自動生成、手動でしか診断できなかった項目の自動化など、生成AI活用により、脆弱性診断の工程の大幅な自動化が可能です。

AeyeScanのようなセキュリティツール以外にも、さまざまなツールにChatGPTが活用されはじめています。ツールの導入を検討する際は、セキュリティに配慮して開発されているか確認しましょう。

ChatGPTのセキュリティ体制構築には専門チームの設置が重要

ChatGPTを安全に活用するための対策を実施する際、忘れてはならないのがセキュリティインシデント対応体制の整備です。どれほど予防策を講じても、新しい攻撃手法やシステムの不具合によって情報漏洩が発生する可能性は完全には排除できません。そこで重要となるのが、セキュリティ事故発生時に迅速な対応を行うCSIRTの設置です。

CSIRTは、ChatGPTを含むAIツール利用時のセキュリティ事故に対して、脆弱性の監視から事故原因の究明、被害拡大の防止まで一元的に対応します。組織内にCSIRTを設置することで、ChatGPT利用に関するセキュリティ事故の情報を効率的に管理し、類似インシデントの再発防止策も策定できます。

CSIRTの設置方法は以下の関連記事で詳しく解説しているので、ぜひ参考にしてください。

▼関連記事

あわせて知っておきたい、ChatGPTセキュリティの2つの側面

ChatGPTを安全に活用するには、組織全体での「無統制なAI利用(シャドーAI)への対策」と、開発プロセスにセキュリティを統合する「DevSecOps体制の構築」が不可欠です。この2つの側面から、より包括的な対策を理解しましょう。

企業全体でのシャドーAI管理と統制

企業のIT部門や経営層の承認を得ずに、従業員が個人判断で業務に利用するAIツールは「シャドーAI」と呼ばれます。ChatGPTなどが手軽に利用できるようになった結果、多くの企業で管理外のAI利用が増加し、新たなセキュリティリスクとなっています。

従業員が個人アカウントでChatGPTを使えば、企業の機密情報が意図せず外部に漏洩するおそれがあります。また、部門ごとに異なるAIツール(例:営業はChatGPT、開発はGitHub Copilot)を導入すると、セキュリティレベルの統一が難しくなり、組織全体のリスクを可視化できなくなってしまいます。

効果的な対策としては、企業レベルでのAI利用ガイドラインの策定や、従業員の利用状況の把握、そして利用ログの管理体制構築が挙げられます。シャドーAIの実態を把握し、適切な管理下で生成AIを活用することで、業務効率化とセキュリティ確保の両立が可能になります。

実践のチェックポイント

- ポイント1:従業員のChatGPT個人利用状況を定期的に調査する

- ポイント2:組織全体でのAI利用統制ルールを明文化する

- ポイント3:シャドーAI発覚時の対応手順を事前に準備する

シャドーAIの具体的なリスクと対策について詳しく知りたい方は、以下の関連記事にて紹介しているので、ぜひご覧ください。

▼関連記事

開発現場におけるセキュリティ強化:DevSecOps体制の構築

ChatGPTなどの生成AIを開発現場で安全に活用するには、開発プロセスの各工程にセキュリティを組み込む「DevSecOps」体制の構築が重要です。DevSecOpsとは、開発(Development)・セキュリティ(Security)・運用(Operations)を統合した開発スタイルで、全工程でセキュリティを意識しながら開発を進めます。

コーディング支援AIを利用する際、機密性の高いソースコードや技術仕様を誤って入力してしまうリスクがあります。DevSecOps体制を構築すれば、開発の各段階でセキュリティチェックを実施できるため、AIツール利用時の情報漏洩リスクを最小限に抑えることが可能です。

具体的には、AI利用に関するガイドラインの策定、機密情報を含むコードのフィルタリング、開発チーム向けのセキュリティ教育、継続的な監視体制の構築が求められます。また、AIが生成したコードに脆弱性が含まれる可能性も考慮し、自動テストやセキュリティ検証を開発プロセスに組み込む必要があります。

実践のチェックポイント

- ポイント1:開発チーム向けのChatGPT利用ガイドラインを作成する

- ポイント2:コードレビュー時にAI生成コードの安全性を検証する

- ポイント3:継続的なセキュリティ監視とインシデント対応体制を整備する

DevSecOpsを通じた安全な開発体制について詳しく知りたい方は、以下の関連記事にて紹介しているので、ぜひご覧ください。

▼関連記事

OpenAIによるセキュリティ対策の現状

前述のインシデント事例を受けて、ChatGPTを開発・運営するOpenAIは、個人情報保護のために以下の対策を実施していると公表しています。

|

OpenAI側でもセキュリティ強化に取り組んでいますが、システム側の対策だけでは完全にリスクを排除することはできません。企業や利用者側での適切な対策の実施が、ChatGPTを安全に活用する上で不可欠となっています。

まとめ|ChatGPTの情報漏洩リスクを理解して適切な対策をしよう

ChatGPTをはじめとするAI技術の活用は、現代のビジネス環境において欠かせないものとなっています。しかし、その利便性の裏側には情報漏洩のリスクも潜んでいるため、適切な対策の実施が重要です。

本記事で紹介した実際の事例からも明らかなように、ChatGPTの利用には企業の機密情報漏洩、システムバグによる履歴漏洩、個人情報流出などのリスクが存在します。これらのリスクは、組織レベルでのガバナンス体制の構築と、開発現場での適切なリスク管理の両面での対策が必要です。

ChatGPTを安全に活用するには、以下の対策が効果的です。

- 個人情報や機密情報を入力しない

- チャット履歴を残さない設定にする

- API連携を活用する

- ChatGPTの企業向けプランを利用する

また、以下を実施すれば、ChatGPTをより安全に利用できます。

- 社内におけるChatGPTの利用ガイドラインを明確化する

- アカウント管理を適切に行う

- セキュリティに配慮したツールを導入する

本記事で紹介した対策を適切に実施することで、ChatGPTの情報漏洩リスクを最小限に抑えつつ、革新的な機能を最大限に活用できます。生成AIの恩恵を享受しながら、常にセキュリティ意識を持って利用しましょう。

著者:榊原敦子(シニアカスタマーマーケティングマネージャー)